Forskere viser vejen: AI-modeller behøver ikke at sluge SÅ meget strøm

Udviklingen af AI-modeller er en overset klimasynder. Forskere fra Københavns Universitet har lavet en opskriftsbog over AI-modeller, der kan yde det samme, men bruger meget mindre energi. Energiforbruget og klimaaftrykket bør være et fast parameter, når man designer og træner AI-modeller, argumenterer forskerne.

At det koster kolossale mængder energi, når vi googler, taler med Siri, spørger ChatGPT om noget eller på andre måder bruger AI, er efterhånden blevet almen viden. Et studie anslår, at AI-servere i 2027 vil have et lige så stort elforbrug som Argentina eller Sverige. Og en enkelt forespørgsel til ChatGPT er anslået til i gennemsnit at sluge lige så meget energi som 40 opladninger af en mobiltelefon. Men på forskningsfeltet og i branchen har man stadig ikke fokus på at udvikle AI-modeller, som er energieffektive og derfor har et mindre CO2e-aftryk, påpeger forskere fra Københavns Universitet.

“Udviklerne har i dag et snævert fokus på at bygge AI-modeller, der er effektive i form af, hvor præcist et resultat, de kan opnå. Det svarer til at sige, at en bil er effektiv, fordi den får dig hurtigt frem, men ignorerer den mængde brændstof, den bruger. Og det har resulteret i AI-modeller, som ofte er ineffektive i form af energiforbrug,” siger adjunkt Raghavendra Selvan fra Datalogisk Institut, som forsker i mulighederne for at sænke CO2e-aftrykket fra AI.

Men det nye studie, som han og datalog-studerende Pedram Bakhtiarifard er to af forfatterne bag, viser, at man sagtens kan spare masser af CO2 uden at gå på kompromis med AI-modellens præcision. Det kræver, at man har klimaomkostninger for øje allerede i AI-modellernes design- og træningsfase.

”Hvis man fra start sammensætter en model, der er energieffektiv, mindsker du både CO2e-aftrykket i alle faser af modellens ’livscyklus’. Det gælder både i træningen af den, som er en særlig energitung proces, der ofte tager uger eller måneder, og i anvendelsen af den,” siger Raghavendra Selvan.

Opskriftsbog til branchen

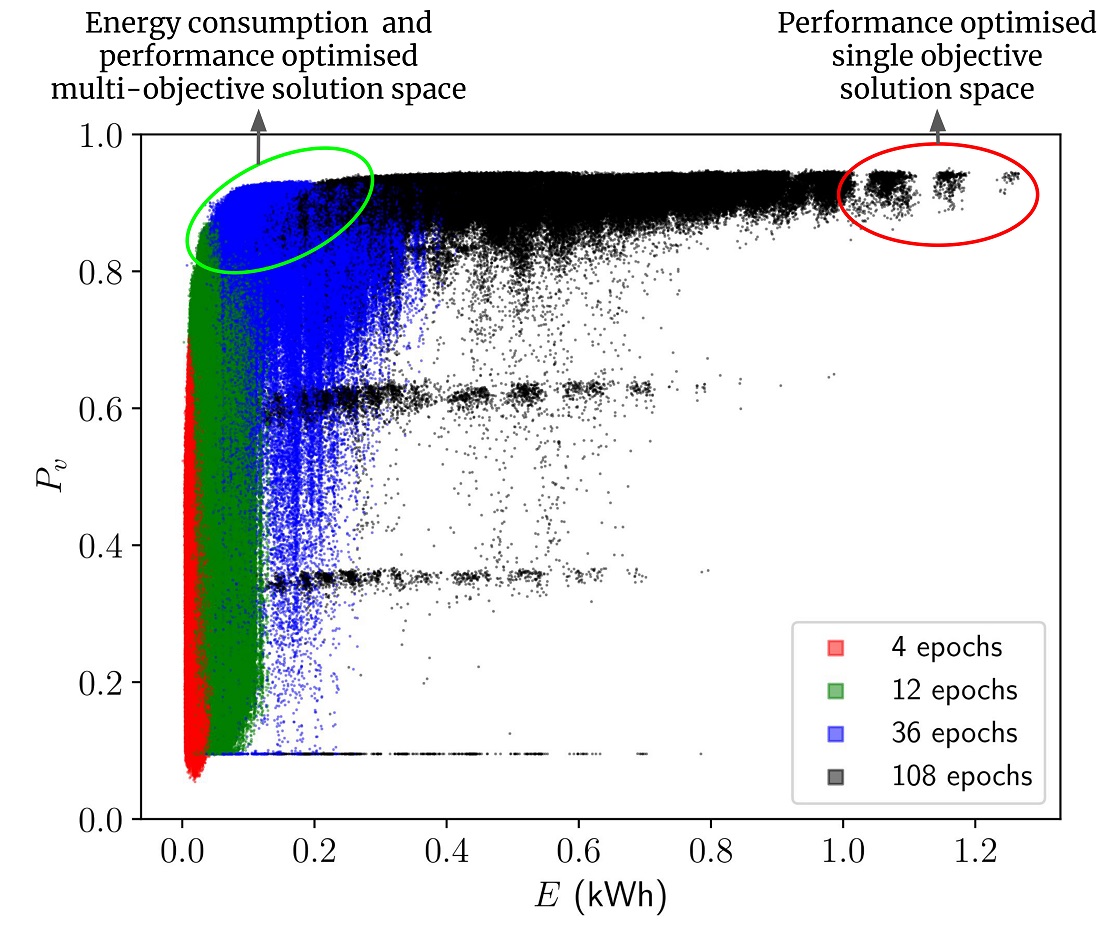

I studiet har forskerne beregnet, hvor meget energi, det kræver at træne over 400.000 AI-modeller af typen convolutional neural networks – dog uden faktisk at træne alle modellerne. Convolutional neural networks bruges bl.a. til at analysere medicinske billeder med, til sprogoversættelse og til genkendelse af objekter og ansigter – en funktion, du måske genkender fra kamera-app’en på din egen smartphone.

På baggrund af beregningerne præsenterer forskerne en samling af AI-modeller, som bruger mindre energi på at løse en given opgave, men som yder cirka det samme. Studiet viser, at man enten ved at vælge andre slags modeller eller justere på modellerne kan spare 70-80% energi i trænings- og implementeringsfasen og kun gå 1% eller mindre ned i ydeevne. Og det er ifølge forskerne et konservativt estimat.

”Man kan se vores resultater som en opskriftsbog, som AI-fagkyndige kan slå op i. Opskriftsbogen fortæller ikke bare, hvor godt de forskellige algoritmer yder, men også hvor energieffektive de er. Og at man ved at skifte en ingrediens ud med en anden i opbygningen af modellen, ofte kan opnå samme resultat. Så nu kan fagfolk vælge den model, de ønsker ud fra både ydeevne og energiforbrug og uden at skulle træne hver enkelt model først,” siger Pedram Bakhtiarifard og fortsætter:

”Ofte træner man nemlig mange modeller, før man finder den, man synes er mest egnet til at løse en bestemt opgave. Det gør udviklingen af AI ekstra energitung. Derfor ville det være mere klimavenligt, hvis man vælger den rigtige model i første hug og samtidig vælger en model, der ikke sluger alt for meget strøm i træningsfasen.”

Forskerne understreger, at på specifikke felter som selvkørende biler eller visse medicinske områder kan modellens præcision dog være afgørende for sikkerheden, og her er det vigtigt ikke at gå på kompromis med ydeevnen. Men dette bør ikke afholde fra at gå efter høj energieffektivitet i andre domæner.

“AI har et fantastisk potentiale. Men skal vi sikre en bæredygtig og ansvarlig AI-udvikling, bør vi have en mere holistisk tilgang, der ikke kun har ydeevne for øje, men også klimapåvirkning. Og det kan vi sagtens finde en bedre balance i, viser vi her. Når vi udvikler AI-modeller til forskellige opgaver, bør det derfor være et grundkriterium også at kigge på, hvor energieffektive de er – ligesom det er standard at gøre i mange andre brancher,” slutter Raghavendra Selvan.

Opskriftsbogen, som forskerne har sat sammen i dette studie, er et open-source-datasæt, som andre forskere kan bruge. Informationen om alle de 423.000 AI-modeller er offentliggjort på Github og kan tilgåes ved hjælp af simple Python scripts.

Kontakt

Raghavendra Selvan

Adjunkt

Datalogisk Institut

Københavns Universitet

raghav@di.ku.dk

31 87 30 52

Pedram Bakhtiarifard

KA-studerende

Datalogisk Institut

Københavns Universitet

pba@di.ku.dk

60 21 99 10

Maria Hornbek

Journalist

Det Natur- og Biovidenskabelige Fakultet

Københavns Universitet

maho@science.ku.dk

22 95 42 83